Perdebatan tentang kontroversi label konten AI kini merambah dari ruang teknis ke ruang publik. Di satu sisi, label dianggap perlu untuk memberi tahu pembaca bahwa sebuah teks, gambar, atau video dibuat atau dibantu kecerdasan buatan. Di sisi lain, muncul kecurigaan bahwa label ini justru bisa dijadikan alat kendali, sensor halus, hingga senjata persaingan bisnis. Pertarungan wacana ini bukan sekadar soal teknologi, tetapi menyentuh isu kepercayaan, etika, dan kekuasaan dalam ekosistem informasi digital.

Mengapa Kontroversi Label Konten AI Meledak Sekarang

Lonjakan pemakaian AI generatif membuat internet dibanjiri konten baru dalam skala yang belum pernah terjadi sebelumnya. Dalam hitungan detik, siapa pun bisa membuat artikel, ilustrasi, jingle, atau video pendek. Di tengah arus ini, kontroversi label konten AI muncul karena publik merasa kesulitan membedakan mana karya manusia dan mana hasil mesin, sementara platform digital dan regulator bergerak dengan aturan yang belum matang.

Tekanan datang dari berbagai arah. Pemerintah khawatir akan hoaks dan manipulasi pemilu berbasis AI. Industri kreatif resah karena karya mereka tersaingi konten otomatis yang murah dan massal. Pengguna biasa takut tertipu oleh testimoni palsu, foto editan yang realistis, atau berita yang tampak sahih padahal disusun algoritma. Label konten AI kemudian dipromosikan sebagai solusi kompromi untuk mengurangi kebingungan ini.

Namun, ketika perusahaan teknologi mulai menerapkan label otomatis, muncul pertanyaan baru. Seberapa akurat penandaan itu? Siapa yang menentukan standar? Apakah label akan diterapkan secara adil, atau hanya pada pihak tertentu? Di titik inilah kontroversi label konten AI berubah menjadi isu kepercayaan terhadap para pengelola platform.

Di Balik Janji Transparansi Label Konten AI

Label konten AI diperkenalkan dengan janji utama transparansi. Pengguna diberi kesempatan mengetahui bahwa sebuah konten dihasilkan atau dimodifikasi oleh sistem kecerdasan buatan. Dalam teori, hal ini dianggap akan meningkatkan literasi digital dan membantu publik menilai kredibilitas informasi.

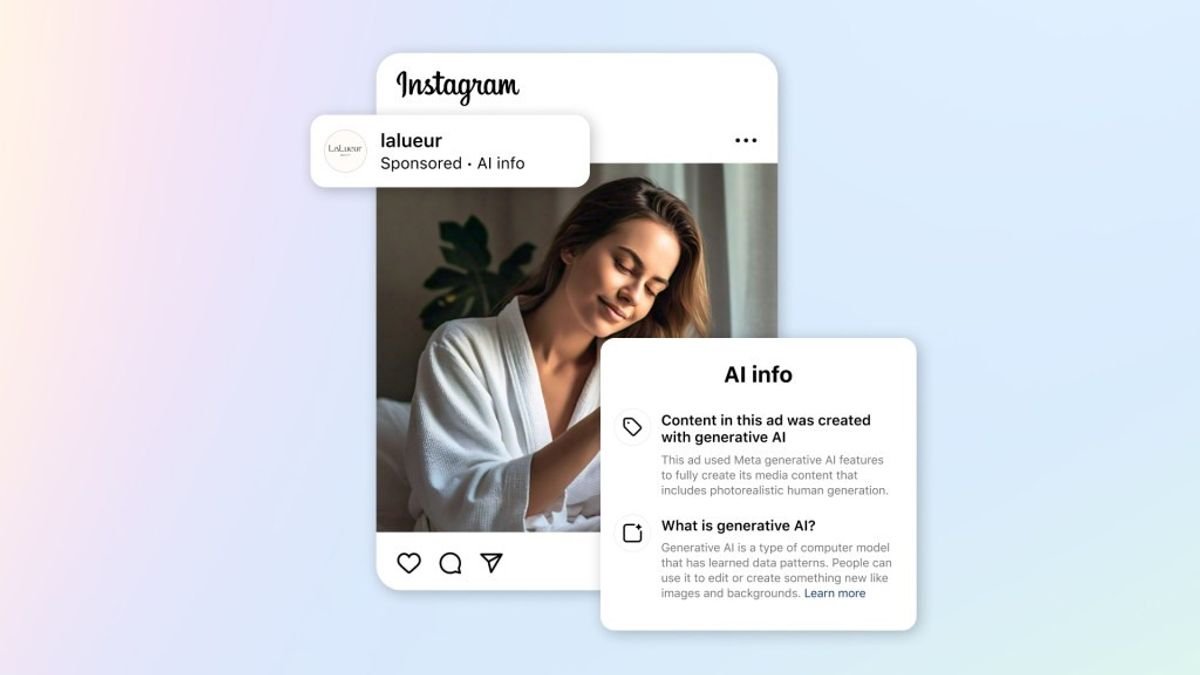

Secara teknis, label bisa muncul dalam bentuk teks kecil di bawah judul, ikon khusus pada gambar, atau keterangan tambahan di metadata. Ada platform yang mengandalkan deteksi otomatis berdasarkan pola bahasa dan struktur visual, ada pula yang meminta kreator menandai sendiri jika konten mereka melibatkan AI. Di atas kertas, mekanisme ini tampak rapi dan masuk akal.

Namun implementasi di lapangan jauh lebih berantakan. Konten yang murni buatan manusia kadang ikut ditandai sebagai AI, sementara konten manipulatif yang jelas mengandalkan kecerdasan buatan lolos tanpa label. Perbedaan kebijakan antarplatform memperparah kebingungan. Apa yang dianggap perlu label di satu aplikasi, bisa saja dibiarkan bebas di aplikasi lain.

“Label konten AI seharusnya menjadi jendela transparansi, bukan tirai baru yang justru menutupi bagaimana keputusan di balik layar diambil.”

Di sinilah janji transparansi berbalik arah. Alih alih membuat pengguna lebih paham, kebijakan yang tidak konsisten justru menimbulkan rasa curiga. Publik mulai bertanya, apakah label ini benar benar demi keterbukaan, atau hanya tameng agar perusahaan terlihat bertanggung jawab di mata regulator.

Kontroversi Label Konten AI di Ruang Berita dan Jurnalisme

Dunia jurnalisme menjadi salah satu arena paling sensitif dalam kontroversi label konten AI. Media arus utama berlomba menegaskan bahwa mereka masih mengandalkan reporter manusia, sekaligus diam diam memanfaatkan AI untuk membantu riset, menyusun draft, atau mengedit naskah. Di tengah tarik menarik ini, label menjadi semacam garis batas yang terus dinegosiasikan.

Beberapa redaksi mulai menambahkan keterangan jika sebuah artikel ditulis dengan bantuan AI, meski tetap melalui penyuntingan jurnalis. Yang lain memilih hanya mengakui penggunaan AI di bagian tertentu, misalnya untuk ringkasan atau terjemahan. Ada pula media yang enggan menempelkan label apa pun karena khawatir pembaca menganggap semua konten mereka tidak bisa dipercaya.

Masalah semakin rumit ketika algoritma platform berita dan media sosial turut menentukan visibilitas. Konten yang dilabeli AI bisa saja diprioritaskan lebih rendah, baik demi mengurangi risiko misinformasi maupun karena dianggap kurang “organik”. Akibatnya, media yang jujur menandai kontennya justru terancam kalah bersaing dengan pihak yang menyembunyikan penggunaan AI.

Kekhawatiran juga datang dari sisi etika. Jika sebuah berita sensitif seperti laporan konflik, bencana, atau isu kesehatan disusun dengan bantuan AI, pembaca berhak tahu sejauh mana mesin terlibat. Namun, jika semua bentuk bantuan teknis dipaksa untuk selalu dilabeli, batas antara alat bantu dan penulis utama menjadi kabur. Mikroedit tata bahasa oleh AI, misalnya, apakah juga harus memicu label yang sama dengan artikel yang sepenuhnya dihasilkan model bahasa?

Ketika publik membaca berita yang membawa label “dibantu AI”, mereka kerap langsung mempertanyakan validitas isi, meski fakta dan data tetap diverifikasi wartawan. Label yang dimaksudkan sebagai penjelasan akhirnya berubah menjadi stempel kecurigaan.

Ketakutan Kreator Konten di Tengah Kontroversi Label Konten AI

Bagi kreator individu, terutama penulis lepas, ilustrator, dan pembuat video, kontroversi label konten AI menghadirkan dilema baru. Banyak di antara mereka memanfaatkan AI sebagai alat bantu, misalnya untuk brainstorming ide, menyusun outline, atau menghasilkan referensi visual. Namun mereka khawatir jika mengakui penggunaan AI akan menurunkan nilai karya di mata klien dan audiens.

Di sejumlah platform, konten berlabel AI mendapat engagement lebih rendah. Pengiklan ragu menempatkan produk mereka di samping materi yang dianggap kurang “asli”. Hal ini mendorong sebagian kreator menyembunyikan penggunaan AI, atau memindahkan produksi ke platform yang belum menerapkan kewajiban label ketat. Transparansi yang dipaksakan tanpa perlindungan bagi kreator justru mendorong praktik bawah tanah.

Di sisi lain, ada pula kreator yang menuntut label lebih tegas untuk melindungi karya mereka dari plagiarisme berbasis AI. Mereka ingin algoritma dapat mendeteksi ketika gaya visual atau gaya penulisan mereka ditiru model generatif tanpa izin. Ironisnya, teknologi pelabelan yang tersedia saat ini lebih fokus menandai output AI, bukan melacak sumber inspirasi yang diambil dari kreator manusia.

Kondisi ini memunculkan rasa ketidakadilan. Kreator yang karyanya dijadikan data latih AI sering kali tidak pernah diberi label atau kredit, sementara mereka justru berisiko distigma ketika menggunakan AI sebagai alat bantu kerja sehari hari.

Ketika Kontroversi Label Konten AI Menyentuh Politik dan Regulasi

Ranah politik menjadi salah satu medan paling sensitif dalam kontroversi label konten AI. Pemerintah di berbagai negara mulai mendorong aturan yang mewajibkan pelabelan konten AI, terutama untuk materi politik, iklan kampanye, dan konten yang berpotensi memengaruhi opini publik menjelang pemilu.

Gagasan dasarnya tampak masuk akal. Deepfake, suara tiruan tokoh publik, dan pesan kampanye yang disusun otomatis bisa memicu kekacauan jika tidak dikendalikan. Label konten AI dianggap sebagai pagar minimal agar pemilih tahu kapan mereka berhadapan dengan materi yang dihasilkan mesin.

Namun, ketika regulasi mulai disusun, muncul kekhawatiran bahwa kewenangan menentukan apa yang “AI” dan apa yang “bukan AI” bisa disalahgunakan. Pemerintah atau lembaga tertentu berpotensi menekan platform untuk melabeli konten oposisi secara berlebihan, sementara materi propaganda resmi dibiarkan tanpa penandaan khusus. Di sini, label berubah fungsi menjadi alat delegitimasi.

“Begitu label menjadi senjata politik, kepercayaan publik terhadap seluruh ekosistem informasi digital akan runtuh lebih cepat daripada kemampuan teknologi memperbaikinya.”

Perdebatan juga muncul soal standar internasional. Konten politik yang beredar lintas negara bisa tunduk pada aturan yang berbeda beda. Satu video kampanye mungkin wajib berlabel AI di satu negara, namun bebas beredar tanpa penandaan di negara lain. Ketidaksinkronan ini membuka celah manipulasi lintas batas yang sulit diawasi.

Teknologi di Balik Label dan Keterbatasannya

Dari sisi teknis, label konten AI mengandalkan beberapa pendekatan. Pertama, watermarking atau penanaman penanda digital pada konten yang dihasilkan model tertentu. Kedua, deteksi pola melalui algoritma yang dilatih membedakan karakteristik bahasa atau visual buatan mesin. Ketiga, deklarasi manual oleh kreator yang menandai sendiri penggunaan AI.

Setiap pendekatan memiliki kelemahan. Watermark mudah hilang jika konten diubah, dikompresi ulang, atau digabung dengan materi lain. Deteksi pola tidak selalu akurat, apalagi ketika AI dan manusia saling meniru gaya satu sama lain. Deklarasi manual bergantung pada kejujuran dan kesadaran pengguna, sesuatu yang sulit dijaga di internet yang kompetitif.

Masalah lain muncul ketika berbagai model AI dari vendor berbeda digunakan bersamaan. Tidak ada standar global yang disepakati untuk format watermark atau metadata, sehingga satu sistem pendeteksi belum tentu bisa membaca penanda dari sistem lain. Hasilnya, ekosistem label terfragmentasi, sementara pengguna di ujung rantai hanya melihat stempel sederhana tanpa memahami kerumitan di baliknya.

Dalam kondisi seperti ini, menyandarkan kepercayaan publik pada label semata adalah langkah yang berisiko. Tanpa audit independen dan standar terbuka, label mudah berubah menjadi klaim sepihak yang sulit diverifikasi.

Kontroversi Label Konten AI dan Krisis Kepercayaan Pengguna

Pada akhirnya, kontroversi label konten AI berakar pada krisis kepercayaan yang lebih luas terhadap platform digital dan perusahaan teknologi. Selama bertahun tahun, pengguna merasa keputusan penting tentang algoritma, moderasi, dan prioritas konten diambil tanpa keterbukaan. Label AI lalu muncul di tengah suasana skeptis, sehingga dianggap dengan kacamata curiga sejak awal.

Sebagian pengguna memandang label sebagai bentuk kejujuran minimal yang seharusnya sudah lama ada. Namun sebagian lain melihatnya sebagai upaya mengalihkan perhatian dari persoalan lebih besar, seperti pengumpulan data masif, bias algoritma, dan monopoli distribusi informasi. Di mata kelompok kedua ini, label hanya kosmetik yang tidak menyentuh akar masalah.

Di tengah kebingungan itu, masyarakat tetap harus menavigasi arus konten yang kian deras. Mereka dihadapkan pada pilihan sulit antara percaya pada label yang belum tentu akurat, atau mengabaikannya dan mengandalkan naluri kritis sendiri. Keduanya menuntut literasi yang tinggi, sesuatu yang tidak selalu dimiliki semua kalangan.

Jika kontroversi label konten AI tidak ditangani dengan serius, risiko terbesarnya adalah kelelahan kepercayaan. Pengguna yang merasa terus menerus dipermainkan oleh aturan yang berubah ubah bisa memilih untuk tidak percaya apa pun yang mereka lihat di layar. Dan ketika kepercayaan runtuh, bukan hanya teknologi yang dipertanyakan, tetapi juga institusi sosial yang bergantung pada arus informasi digital.

Comment